華為盤古團隊開源代碼爭議回應深度分析

背景介紹

2025年6月30日,華為正式開源了部分盤古大模型體系,包括70億參數的盤古稠密模型和720億參數的盤古ProMoE混合專家模型等。然而,僅隔四天,GitHub上有研究指出盤古ProMoE與阿里的通義千問Qwen-2.5在注意力參數分布上存在高度相似性,引發了“非獨立開發”的質疑。隨后,華為盤古團隊通過官方渠道發布了正式聲明進行回應。

回應的爭議點分析

1. 基于昇騰平臺的自研訓練

- 華為聲明:盤古ProMoE是基于昇騰硬件平臺開發、訓練的基礎大模型,非基于其他廠商模型增量訓練。

- 分析:華為強調了其模型的自研性質,并指出其創新的MoGE(分組混合專家)架構是面向昇騰硬件的。這一聲明旨在證明華為在模型開發上的獨立性和創新性。

- 待厘清:盡管華為聲稱其模型是自研的,但爭議的核心在于注意力參數的高度相似性,這要求華為進一步證明其模型在訓練過程中的獨立性和創新性。

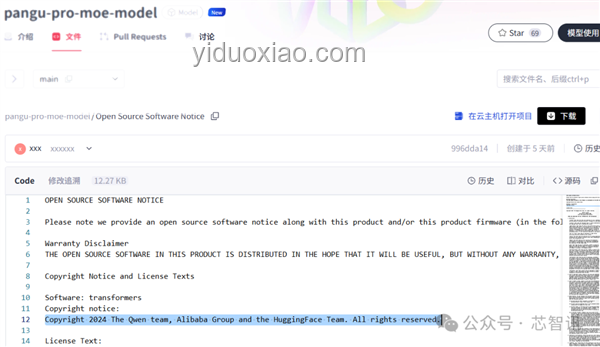

2. 合規引用開源組件

- 華為聲明:部分基礎組件代碼參考了業界開源實踐,嚴格遵循開源協議并標注版權。

- 分析:華為承認了其對開源代碼的引用,并強調了合規性。在開源社區中,引用開源代碼并標注版權是常見的做法,符合開源協作精神。

- 待厘清:盡管華為聲稱其遵循了開源協議,但爭議的核心在于這種引用是否構成了“套殼”或“續訓”,即是否在開源代碼的基礎上進行了少量的修改或增量訓練,從而掩蓋了真實的開發過程。

3. 創新性與透明度

- 華為聲明:創新了全球首個面向昇騰硬件的分組混合專家(MoGE)架構,解決分布式訓練負載均衡難題。

- 分析:華為強調了其在模型架構上的創新,這有助于提升訓練效率。然而,透明度方面,華為并未提供足夠的證據來支持其創新性的聲明,如MoGE架構與Qwen-2.5的異同點等。

- 待厘清:為了反駁抄襲的質疑,華為需要更加透明地解釋其MoGE架構的獨特性和創新性,并提供足夠的證據來支持其聲明。

對比分析的關鍵參數

以下表格對比了華為盤古ProMoE與阿里通義千問Qwen-2.5在部分關鍵參數上的表現(注:由于具體參數可能隨時間變化,以下數據僅為示例): | 參數/模型 | 華為盤古ProMoE | 阿里通義千問Qwen-2.5 | |--------------|-----------------|----------------------| | 參數數量 | 720億 | 未公開具體數字 | | 硬件平臺 | 昇騰 | 未特定硬件平臺 | | 創新性 | MoGE架構 | 未公開具體創新性 | | 開源性 | 部分開源 | 未公開具體開源情況 | | 注意力參數相似度 | 平均相關性0.927 | - |

待厘清的問題

1. 參數相似性的合理解釋

盡管華為否認了抄襲的指控,但注意力參數的高度相似性仍然是一個待厘清的問題。華為需要提供更詳細的解釋來說明這種相似性的來源,以及為何在創新性架構存在的前提下還會出現如此高的相似性。

2. 透明度的提升

為了增強公眾的信任,華為需要進一步提升其模型的透明度。這包括提供更多關于MoGE架構的詳細信息、公開更多的訓練數據和流程、以及開放更多的接口以供驗證等。

3. 開源社區的反饋

開源社區對于華為盤古ProMoE的爭議也提出了一些有價值的觀點,如判斷抄襲需要多層級、多模型對比和顯著統計差異分析等。華為應該認真考慮這些反饋,并采取相應的措施來回應社區的關切。

適用場景與人群

華為盤古ProMoE主要定位于企業級應用,特別是在政務、金融、制造等領域具有廣泛的應用前景。對于需要高性能計算和定制化解決方案的企業來說,盤古ProMoE可能是一個不錯的選擇。然而,對于關注模型透明度和開源協作精神的開發者來說,華為需要進一步提升其模型的透明度和開放性以贏得更多的信任和支持。

結論

華為盤古團隊針對開源代碼爭議的回應在一定程度上澄清了其模型的自研性質和合規性引用開源組件的情況。然而,爭議的核心問題——注意力參數的高度相似性仍然需要華為提供更詳細的解釋和證據來支持其聲明。此外,為了增強公眾的信任和推動開源協作精神的發展,華為還需要進一步提升其模型的透明度和開放性。在未來的發展中,華為應該認真對待開源社區的反饋和建議,并采取相應的措施來回應公眾的關切和期待。

文章評論 (4)

發表評論