OpenAI o1技術原理概述

隱藏思維鏈(Hidden COT)的生成

OpenAI o1的推出,無疑是人工智能領域的一次重大革新。其核心在于通過強化學習(RL)與大型語言模型(LLM)的融合,實現了隱藏思維鏈(Hidden COT)的生成。這一過程不僅顯著增強了模型的復雜邏輯推理能力,還帶來了諸多其他方面的技術進步。Hidden COT作為o1的核心輸出,展示了模型在解決問題時的內部思考過程,這一過程是線性的,但模型的內部思考機制卻遠非如此簡單。

自我反思與錯誤修正能力

與GPT 4等前代模型相比,o1在輸出答案時展現出了顯著的自我反思與錯誤修正能力。由于GPT 4等模型在輸出答案是逐個Token(詞元)進行,當輸出長度較長時,中間某些Token出錯難以避免。而一旦出錯,模型為了保持邏輯合理性,往往會用后續的錯誤來掩蓋前面的錯誤,這種現象被稱為“大模型幻覺”。o1則能在生成Hidden COT的過程中意識到之前的錯誤,并自動進行修正,這種能力對于長鏈條思考和解決復雜任務至關重要。

OpenAI o1的重要意義

新型RL的Scaling law

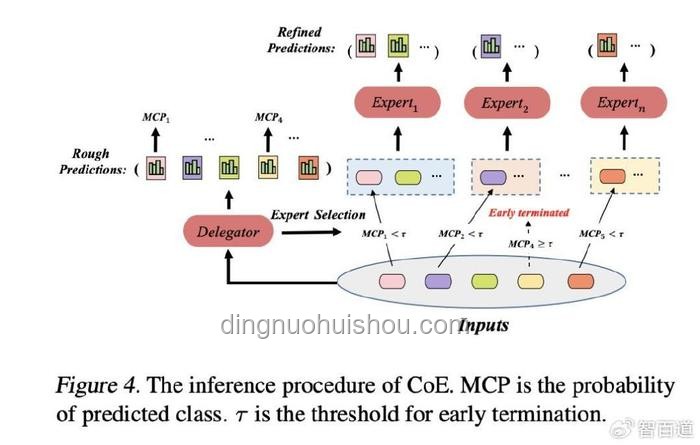

OpenAI o1的推出,不僅帶來了技術上的突破,還揭示了一種新型的RL擴展定律(Scaling law)。o1可能采用了類似AlphaGo的MCTS(蒙特卡洛樹搜索)樹搜索或簡單樹結構拓展(如Best-of-N Sampling),這種策略在連續使用時形成了一種簡單的樹搜索結構。這種方法的可擴展性極好,無論是在RL訓練階段,還是LLM的Inference階段,只需通過調整參數配置來增加樹搜索的寬度和深度,就能通過增加算力提升效果。

o1 mini與邏輯推理能力的提升

值得注意的是,o1的這一特性在小模型o1 mini上同樣得到了體現。盡管小模型在語言能力和世界知識方面表現不俗,但邏輯推理能力一直是其短板。然而,o1 mini卻展現出了強大的邏輯推理能力,且可通過配置來提升或降低這一能力。這表明,通過融合LLM和樹搜索,小模型的邏輯推理能力也能得到顯著提升。

“能力分治”(DCA)模式與小模型的發展

o1的推出為小模型的發展帶來了新的可能。由于小模型在邏輯推理能力上受限,其能力上限一直難以突破。然而,o1 mini的成功表明,通過采用“能力分治”(DCA)模式,即將語言、世界知識及邏輯推理三個能力解耦,小模型完全可能具備目前最強大模型的能力。語言能力靠小模型自身,邏輯推理靠類似o1的通過RL獲得的深度思考能力,而世界知識可以靠外掛RAG獲得增強。這種模式為小模型掃清了前進路上的障礙,未來有望成為研發小模型的新范式。

安全對齊的新范式

在安全對齊方面,o1也展現出了新的可能。它采用了類似Anthropic的“AI憲法”的思路,通過給定安全守則來指明哪些行為能做,哪些不能做。隨著o1邏輯推理能力的提升,它遵循這些法則的能力也獲得了極大增強,安全能力遠超GPT 4等前代模型。這可能引發安全對齊的新模式:先加強模型的邏輯推理能力,再在此基礎上采取類似“AI憲法”的思路來增強安全能力。

行業趨勢分析

強化學習與LLM的融合趨勢

隨著OpenAI o1的成功推出,強化學習與大型語言模型的融合趨勢愈發明顯。這一融合不僅帶來了邏輯推理能力的提升,還可能引發更廣泛的技術革新。未來,更多的人工智能模型可能會采用這種融合方式,以提升自身的復雜問題解決能力。

小模型的崛起與DCA模式的普及

在o1的推動下,小模型有望在未來崛起為人工智能領域的新勢力。通過采用DCA模式,小模型在保持語言能力優勢的同時,還能獲得強大的邏輯推理能力和世界知識增強。這種模式的普及將極大降低研發成本,使得更多人和機構能夠參與到人工智能技術的研發中來。

安全對齊技術的革新

o1在安全對齊方面的成功實踐,也為未來人工智能技術的發展提供了新的思路。通過加強模型的邏輯推理能力,并采取類似“AI憲法”的思路來增強安全能力,未來的人工智能模型將更加安全、可控。

專業見解與預測

強化學習在非數理領域的拓展

盡管強化學習在數理化、Coding等有標準答案的學科中表現出色,但在沒有明確標準答案、Reward不好量化的領域中,其應用一直受到限制。然而,OpenAI可能已經找到了一些非數理學科的Reward定義方法,并將這種方法通過RL拓展到更多領域。未來,隨著強化學習在非數理領域的不斷拓展,人工智能技術的應用范圍將進一步擴大。

DCA模式對小模型發展的深遠影響

DCA模式的提出,為小模型的發展帶來了深遠影響。通過解耦語言、世界知識和邏輯推理三個能力,小模型能夠在保持語言能力優勢的同時,獲得強大的邏輯推理能力和世界知識增強。這種模式的普及將使得小模型在人工智能領域中的地位得到提升,未來有望成為與大型模型并駕齊驅的重要力量。

人工智能技術的倫理與安全挑戰

隨著人工智能技術的不斷發展,其倫理與安全挑戰也日益凸顯。如何確保人工智能模型的安全性、可控性以及符合社會倫理規范,是未來需要重點關注的問題。OpenAI o1在安全對齊方面的成功實踐,為未來解決這些問題提供了有益的參考。 (注:由于本文為深度分析文章,且涉及的技術細節較為復雜,因此未提供具體圖表。在實際撰寫過程中,可根據需要插入相關圖表以輔助說明關鍵數據。) (Q&A部分可根據讀者反饋和實際需求進行添加,本文暫不展開。)

文章評論 (2)

發表評論